[기술스터디] Cheapfake(Shallowfake)란 무엇일까요?

삼성 SDS 인사이트 리포트, 소셜크리에이터 유효선 프로, Cheapfake(Shallowfake)란 무엇일까요?, 2022.05.03

https://www.samsungsds.com/kr/insights/220503deepfake_2.html?moreCnt=0&backTypeId=&category=

Cheapfake(Shallowfake)란 무엇일까요?

인공지능(Artificial Intelligence, AI)을 기반으로 이미지, 비디오와 같은 미디어를 합성, 생성하는 딥페이크. 그렇다면 딥페이크 기술이 나오기 이전에는 미디어 위·변조는 어땠을까요?

www.samsungsds.com

+ 추가 참고(https://en.ejo.ch/ethics-quality/the-cheapfake-photo-trend-fuelling-dangerous-propaganda)

현대 기술이 발달함에 따라 새로운 형태의 범죄들이 잇따라 발생하고 있다.

그 중 대표적인 것이 인공지능의 발달 과정에서 나온 딥페이크 기술이다. 딥페이크(Deefake)란, 인공지능(Artificial Intelligence, AI)을 기반으로 이미지, 비디오와 같은 미디어를 합성하고 생성하는 기술이다. 공익적인 목적으로는 얼마든지 편리한 용도로 사용될 수 있겠지만 연예인이나 기타 여성들의 얼굴과 노출있는 몸을 합성시켜 부적절한 유해물들을 만들어내는 경우가 많다. 딥페이크 기술이 나오기 전이라고 미디어를 위 변조하는 범죄가 없었던 것은 아니다. 그 이전에도 비디오나 이미지 에디터 프로그램을 이용해 수동화된 위 변조 미디어들이 속출했다.

최근에는, 짧은 시간과 적은 노력으로 위변조된 이미지를 만들어낼 수 있다는 의미로 칩페이크(Cheapfake)라고 일컫거나, 딥페이크(Deepfake)와 대조된다는 의미로 쉘로우페이크(Shallowfake)라고 불리우는 범주가 나타나기 시작했다. 이는 정교한 딥페이크와는 결을 달리한다. 칩페이크는 조잡한 기술을 가진 '싸구려 가짜'로 취급되며, 가볍고 빠르게 만들 수 있는 싸구려 페이크의 트렌드가 퍼지고 있는 중이다.

*Deep(깊은) <-> Shallow(얕은)

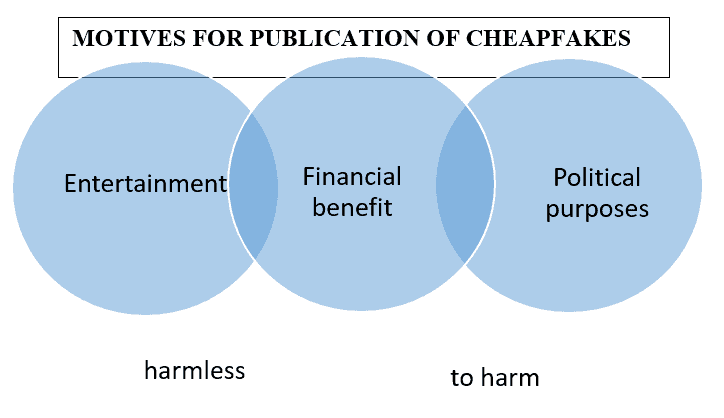

칩페이크와 딥페이크의 차이성은 정교함에 있다. '싸구려 가짜'에서 오는 어감이 칩페이크가 치명적이지 않을 것 같은 느낌을 주지만 그렇지 않다. 컴퓨터나 소프트웨어를 이용해 클릭 한 번이면 위변조 미디어를 생성할 수 있는 칩페이크의 범위는 무해한 오락에서부터 정치적 선전에까지 다양한 영향력을 끼치고 있다.

바로 다음 사진이 그 예시이다. 오른쪽의 사진은 코소보 전쟁 중 1999년에 게시된 Reuters의 사진이다. 2000명의 다른 난민들과 함께 Blace 국경 검문소에서 북마케도니아로 들어가려 시도하고 있던 알바니아 여성의 모습이 찍혀있다. 이 사진은 칩페이크에 의해 위변조된 형태로 10년이 지난 2019년에 다시 나타났다. 편집된 사진은 사진 속 여성이 NATO 폭격의 세르비아인 희생자라는 것처럼 암시하고 있다. 남아프리카 주재 러시아 대사관은 트위터 피드에 왼쪽의 이미지를 게시했다 .

*배경지식

코소보 전쟁은 유고슬라비아(세르비아) 연방공화국과, 그들의 영토에 거주하고 있던 코소보 알바니아인들의 분리독립 요구로부터 발발한 유혈전쟁이다. 해당 과정에서 NATO(북대서양 조약 기구)에 의한 대규모 폭격 등의 직접적인 개입이 있었다.

-> 유고슬라비아(세르비아) vs 알바니아인, NATO

이 칩페이크로 조작된 이미지는 1999년 코소보 전쟁 과정에서 잘못된 나토 개입으로 인한 세르비아와 러시아의 억울함을 지지하는 것처럼 보인다. NATO의 미사일 폭격으로 인해 세르비아의 민간인이 피해를 입었다는 상황을 호소하는 것이다. 해당 위변조 이미지는 전쟁 진압을 위해 개입했던 다국적군 참여국 NATO의 폭격에서의 생존자를 묘사하고 있지만, 사실 이 여성은 세르비아군에 의해 고향을 떠나야 했던 알바니아계 난민이다.

위·변조 기술들이 나날이 발전함에 따라 위·변조 미디어를 탐지하는 기술의 중요성도 커지고 있다. 'Google에서 이미지 검색'으로 원본 이미지가 존재하는지 검색할 수도 있고, 사진이 처음 온라인에 게시된 시기를 알려주는 'TinEye'를 사용할 수도 있으며 사진이 편집되었는지, 어떤 부분이 변경되었는지 확인하는 무료 도구인 fotoforensices.com 을 이용할 수도 있다.

- Google 이미지 검색으로 원본 이미지 탐색

- TinEye - 처음 온라인에 게시된 일자를 알려주는 도구

- fotoforensices.com - 사진이 편집되었는지 어떤 부분이 변경되었는지 확인하는 사이트

이상은 외국 뉴스를 인용한 내용이었고, 삼성 SDS의 원글에서는 팀나인에서 실제 만들어낸 칩페이크 미디어 탐지 기술 중 하나를 소개하고 있다.

*팀나인 : AI를 활용한 멀티미디어 위변조에 대응하는 삼성SDS 사내벤처

팀나인이 고객사로부터 탐지를 요청받은 칩데이터 미디어를 기반으로, 이미지를 분석해가는 과정을 설명하고 있다.

1. 사물 그대로를 촬영한 이미지,

2. 원본 이미지를 종이로 출력하여 촬영한 이미지,

3. 원본 이미지를 스크린으로 출력해 촬영한 이미지

세 가지 분류의 이미지가 확대했을 때의 미세한 패턴 차이가 있다는 것을 발견하고, 이 세 가지의 분류를 자동화하기 위해 인공지능을 접합시킨 것이다.

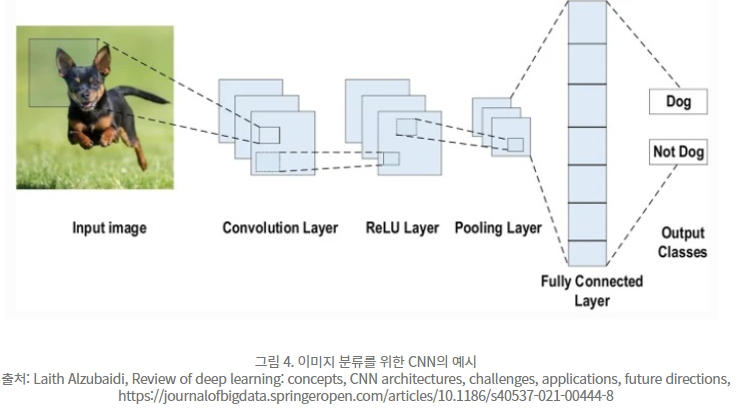

팀나인에서는 이를 원본 이미지와 사본 이미지를 분류하는 이미지 분류(Image Classification) 문제로 정의했다. 그리고, 이미지 분류에 적합한 합성곱신경망(Convolutional Neural Network, CNN)을 접합시켰다.

*배경지식

CNN : 딥러닝 신경망 아키텍처 중 하나로, 이미지와 비디오에서 특정 객체 탐색이나 패턴 검출 등을 이미지 분석에 유용하여 컴퓨터 비전 응용 분야에서 많이 사용되는 알고리즘

팀나인은 CNN을 통해 원본 이미지와 사본 이미지(종이나 스크린으로 출력된 것을 재촬영한 이미지)를 각각 수천여 장씩 촬영하여 학습 이미지 세트를 준비하고 이를 인공지능에 학습시켜 CNN 기반 탐지 모델을 만들어냈다. 초기 모델은 이미지 전체에 초점을 만들어 진행시켜 확대했을 때의 이미지의 특성이 학습되지 않아 정확도가 높지 않았으나, 모델에 이미지를 학습시킬 때 부분 학습 이미지를 연동시켜 함께 학습하도록 유도하면서 이미지가 분류되는 세밀한 패턴을 구분할 수 있게 되었다고 한다.

이렇듯 다양한 방식의 위변조 이미지 탐색기술이 발전하고 있으나 무엇보다도 중요한 것은, 우리들이 ***미디어를 의심하는 것***이다. 다만 보이는 게 전부가 아니라 조작된 이미지에 휘둘리고 있는 것은 아닐지 또 검토하고 휩쓸리지 않도록 주의하는 자세가 필요하다.